Im Studium habe ich einen einfachen Dialog-Agenten programmiert. Das Prinzip war simpel: Eingabe erkennen, Muster abgleichen, passende Antwort zurückgeben.

Keine Intelligenz. Keine Empathie. Kein Verständnis. Ein Programm, das so tut als ob.

Die Illusion eines echten Gesprächs war für mich eben genau das, eine Illusion. Ich wusste, was dahintersteckt. Aber ich habe früh gelernt, dass es nicht allen so geht.

Der erste Chatbot, und eine unangenehme Entdeckung

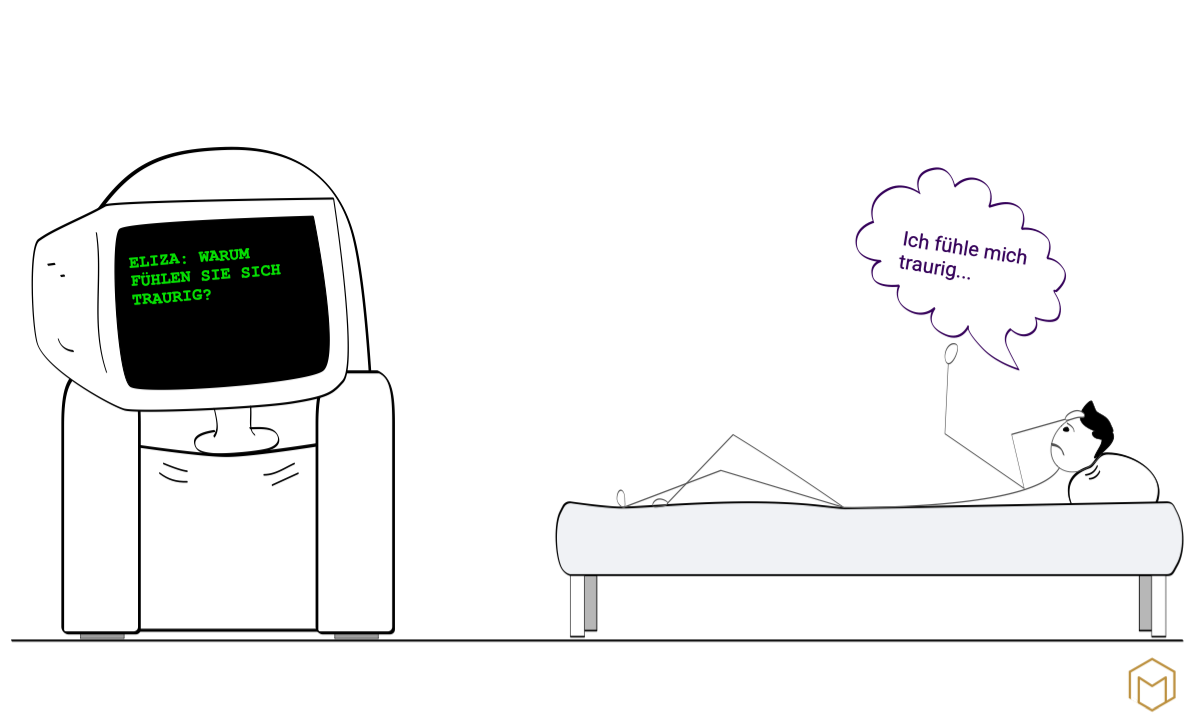

1966 entwickelte Joseph Weizenbaum am MIT ein Programm namens ELIZA. Es simulierte einen Therapeuten durch eine einzige Technik: Es spiegelte zurück, was der Nutzer sagte.

„Ich fühle mich traurig.", „Warum fühlen Sie sich traurig?"

Mehr war es nicht.

Was dann passierte, hat Weizenbaum selbst erschüttert, er beschrieb es ausführlich in seinem Paper von 1966 (https://dl.acm.org/doi/10.1145/365153.365168). Menschen begannen, ELIZA echte Gefühle zuzuschreiben. Sie teilten Geheimnisse. Manche wollten mit dem Programm allein sein. Weizenbaums eigene Sekretärin, die wusste, dass es ein Programm war, bat ihn, den Raum zu verlassen, damit sie ungestört sprechen konnte.

Weizenbaum nannte das den ELIZA-Effekt: die menschliche Tendenz, sprachlich kommunizierenden Systemen Bewusstsein und Absichten zuzuschreiben, auch wenn wir wissen, dass es Maschinen sind.

Was das mit heutiger KI zu tun hat

ChatGPT, Claude, Gemini, moderne Sprachmodelle sind um ein Vielfaches leistungsfähiger als ELIZA. Sie formulieren flüssig, antworten kontextsensitiv, wirken überzeugend kompetent.

Aber der ELIZA-Effekt ist geblieben. Er ist stärker geworden.

Menschen vertrauen KI-Systemen Entscheidungen an, die sie einem menschlichen Berater nie so einfach überlassen würden. Sie hinterfragen Antworten nicht, weil sie so überzeugend klingen.

Der Unterschied ist entscheidend: KI versteht nicht. Sie berechnet.

Was das für die Praxis bedeutet

Der ELIZA-Effekt ist keine Schwäche. Er ist eine menschliche Eigenschaft. Aber wer KI im Unternehmen einführt oder KI-generierte Ergebnisse bewertet, sollte ihn kennen.

Wer weiß, dass KI keine Absichten hat und nichts „meint", stellt bessere Fragen. Trifft bessere Entscheidungen. Und setzt KI dort ein, wo sie wirklich hilft, statt dort, wo sie nur überzeugend klingt.

Quelle: Weizenbaum, J. (1966). ELIZA, A Computer Program for the Study of Natural Language Communication Between Man and Machine.